Cifre significative e notazione scientifica

Definizione

Immaginiamo il caso seguente. A una studentessa viene chiesto di determinare la lunghezza di un cavo. Nel laboratorio sono disponibili vari strumenti di misura; incerta su quale scegliere, esegue la misura con ciascun dispositivo e ottiene risultati diversi:

| Strumentazione di laboratorio chimico. |

Sorgono due questioni fondamentali:

- i valori ottenuti sono da considerarsi equivalenti?

- se non lo sono, quale valore è da ritenere più appropriato?

Le misure non sono equivalenti, e tuttavia possono essere entrambe corrette. La chiave interpretativa è il numero di cifre significative, cioè il conteggio delle cifre sicure più la prima cifra incerta. Supponiamo che, con un righello graduato soltanto in centimetri, si legga 12,7 cm: siamo certi che la lunghezza è maggiore di 12 cm e minore di 13 cm, mentre la prima cifra decimale (7) è una stima. La misura contiene pertanto tre cifre significative. Utilizzando invece un righello con divisioni millimetriche, la lettura risulti 12,68 cm: le cifre 1, 2 e 6 sono determinate, la seconda cifra decimale (8) è stimata; la misura ha quattro cifre significative.

Le due risposte non forniscono la stessa precisione, ma ciascuna è coerente con la risoluzione dello strumento impiegato. Dichiarare una misura con più cifre di quante lo strumento consenta (ad esempio, riferire 12,68 cm con un righello privo di millimetri) introduce una falsa precisione; simmetricamente, riportare 12,7 cm quando si è usato un dispositivo più fine sottoutilizza l’informazione disponibile. In sintesi, è lo strumento a determinare quante cifre significative si possono legittimamente comunicare; un eccesso di cifre indica un’inadeguata valutazione dell’incertezza o, nei casi peggiori, una manipolazione del risultato.

Quando si riportano dati sperimentali o risultati di calcolo, è essenziale includere soltanto le cifre significative. Le regole operative seguenti, di uso standard in fisica e chimica, consentono di stabilirne il numero in un valore numerico:

- tutte le cifre da 1 a 9 sono significative, indipendentemente dalla posizione della virgola decimale; ad esempio, 8,275 contiene quattro cifre significative;

- gli zeri compresi tra cifre non nulle sono significativi; per esempio, 502,03 ha cinque cifre significative;

- gli zeri iniziali (a sinistra della prima cifra non nulla) non sono significativi: fungono solo da segnaposto; così 0,00047 ha due cifre significative;

- gli zeri finali dopo la virgola sono significativi, poiché indicano precisione nella misura; 4,70 ha tre cifre significative;

- gli zeri finali in un numero intero privo di virgola possono essere ambigui; per chiarezza, si preferisce usare la notazione scientifica: 1,20 × 103 indica tre cifre significative, mentre 1,2 × 103 ne indica due;

- i numeri esatti (conteggi o definizioni) hanno un numero infinito di cifre significative: 15 provette (conteggio) o 1 m = 100 cm (definizione) non introducono incertezza;

- nella notazione scientifica, sono significative soltanto le cifre del coefficiente; in \( 6{,}022 \times 10^{23} \) il coefficiente 6,022 possiede quattro cifre significative.

Queste convenzioni garantiscono coerenza tra il dato numerico e la sua incertezza implicita, che coincide con l’ultima cifra riportata.

Numeri molto grandi o estremamente piccoli risultano più leggibili e matematicamente maneggevoli se espressi in forma esponenziale. Nella notazione scientifica un numero si scrive come \( a \times 10^{n} \), con \( 1 \le a < 10 \) e \( n \in \mathbb{Z} \). Questa forma preserva le cifre significative nel coefficiente \( a \) e separa la scala di grandezza nell’esponente \( n \).

Conversione di numeri maggiori di 1: si sposta la virgola di \( x \) posizioni verso sinistra e si moltiplica per \( 10^{x} \), con \( x > 0 \). Per esempio, la distanza media Terra–Luna pari a 384 400 000 m può essere scritta come \( 3{,}844 \times 10^{8} \) m, dove il coefficiente 3,844 ha quattro cifre significative.

Conversione di numeri minori di 1: si sposta la virgola di \( x \) posizioni verso destra e si moltiplica per \( 10^{-x} \), con \( x > 0 \). Ad esempio, un diametro cellulare di 0,000012 m si esprime come \( 1{,}2 \times 10^{-5} \) m, con due cifre significative.

La notazione scientifica è utile anche per chiarire gli zeri finali e, congiuntamente, per controllare le cifre significative. Esempi: \( 7{,}00 \times 10^{2} \) indica tre cifre significative (700, con due zeri significativi), mentre \( 7 \times 10^{2} \) ne indica una sola.

Infine, l’arrotondamento va eseguito in modo coerente con la precisione disponibile: dopo un prodotto o un quoziente, il risultato si riporta con il numero di cifre significantive pari a quello del fattore con meno cifre significative; dopo somme o differenze, la cifra incerta si colloca alla stessa posizione decimale del termine meno preciso. Queste prassi allineano il risultato numerico all’informazione effettivamente giustificata dai dati e dagli strumenti.

Per errore di misura si intende lo scostamento tra il valore “vero” di una grandezza e la sua stima sperimentale. Ogni risultato sperimentale incorpora un errore. Si distinguono due categorie fondamentali: errore casuale ed errore sistematico. L’errore casuale origina da fluttuazioni imprevedibili del processo di misura e si manifesta come dispersione dei dati attorno alla media; l’errore sistematico, invece, introduce uno spostamento costante che rende le misure, in media, tutte più alte o tutte più basse rispetto al valore di riferimento.

Gli errori casuali sono intrinseci all’osservazione sperimentale e non possono essere eliminati del tutto, ma possono essere ridotti attraverso un adeguato protocollo e l’aumento del numero di repliche. Gli errori sistematici, al contrario, possono spesso essere identificati e corretti mediante taratura, controlli di qualità e adeguata progettazione dell’esperimento:

- fonti tipiche di errore sistematico includono: piatti della bilancia sporchi o inclinati, errori di zero e deriva di taratura degli strumenti, correzioni di galleggiamento trascurate in pesata, graduazioni imprecise nelle vetrerie, termometri non calibrati, interferenze dovute a impurezze dei reagenti o a reazioni laterali, rivelatori con risposta non lineare, letture sistematicamente affette da parallasse;

- modalità di mitigazione: tarature tracciabili a campioni di riferimento, utilizzo di bianchi e standard interni, curve di calibrazione, controlli incrociati con metodi indipendenti, randomizzazione e bilanciamento dei fattori sperimentali.

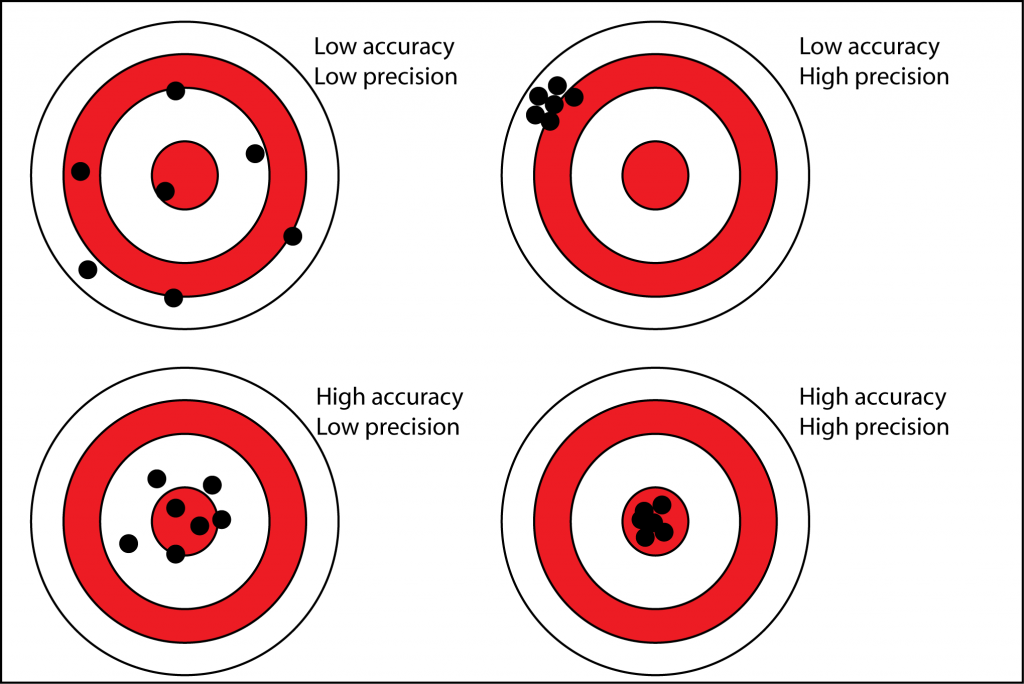

Accuratezza (o veridicità, in senso ISO 5725) indica quanto il valore ottenuto si avvicina al valore di riferimento, mentre precisione esprime il grado di concordanza tra misure ripetute della stessa grandezza nelle medesime condizioni. È possibile avere misure molto ripetibili ma con un bias (alta precisione, bassa accuratezza) o, al contrario, misure poco ripetibili la cui media cade vicino al valore di riferimento (bassa precisione, accuratezza “in media”). Dati di alta qualità combinano entrambe le proprietà.

L’incertezza quantifica l’intervallo entro cui è ragionevole attendersi che cada il valore di riferimento, alla luce delle informazioni disponibili. In termini operativi, essa è legata alla variabilità sperimentale e ai contributi sistematici residui, ed è riportata come parametro associato al risultato della misura.

Quando la grandezza varia o quando la lettura non può contenere infinite cifre, l’incertezza si riflette nelle cifre significative. Il numero di cifre significative comunicabili dipende dalla risoluzione e dalle prestazioni dello strumento. Per esempio, la rappresentazione decimale di una quantità come 1/7 può essere troncata o arrotondata in vari modi: 0,14; 0,143; 0,142857; ecc. Tutti questi numeri sono coerenti con 1/7, ma esprimono livelli diversi di incertezza: 0,14 è la più incerta, 0,142857 la meno incerta tra quelle elencate.

La ripetizione delle misure consente di ridurre l’incertezza casuale dell’esito complessivo. Date misure ripetute \(x_1,\dots,x_n\), la stima della media e della dispersione è:

\(\displaystyle \bar{x}=\frac{1}{n}\sum_{i=1}^{n} x_i,\quad s=\sqrt{\frac{1}{n-1}\sum_{i=1}^{n}\bigl(x_i-\bar{x}\bigr)^2},\quad s_{\bar{x}}=\frac{s}{\sqrt{n}}.\)

In (Figura 01.03-01), il bersaglio (a) rappresenta l’obiettivo ideale: alta accuratezza e alta precisione (dardi concentrati e centrati). Nel bersaglio (b) le misure sono tra loro concordi ma deviate dal centro: precisione elevata e errore sistematico presente. Il bersaglio (c) illustra misure sparse e lontane dal centro: scarsa precisione accompagnata da bassa accuratezza. Un risultato “accurato in media” può talvolta emergere nonostante una bassa precisione, ma non costituisce garanzia di affidabilità; l’esperimento va ottimizzato finché la precisione raggiunge un livello adeguato all’uso.

Le cifre significative indicano il numero di cifre attendibili in una misura, escluse quelle non determinabili con precisione. Nel calcolo dei risultati, il numero di cifre significative va mantenuto in base ai dati meno precisi: nelle moltiplicazioni/divisioni si conserva il numero minore di cifre significative, mentre nelle somme/sottrazioni si rispettano le cifre decimali del valore meno preciso.

Addizione e sottrazione

Nelle somme e nelle differenze, la posizione della virgola è determinante: il risultato va riportato con il numero di cifre decimali uguale a quello dell’addendo o del sottraendo meno dettagliato. Esempio di addizione:

12,3 + 0,456 + 7,89 = 20,646 ⟶ si riporta come 20,6 poiché il termine 12,3 ha una sola cifra decimale.

Per la sottrazione vale la stessa regola. Esempio: 125,07 − 24,8 = 100,27 ⟶ 100,3 (una cifra decimale).

Moltiplicazione e divisione

Per prodotti e quozienti, conta il numero di cifre significative, non la posizione della virgola. Il risultato si esprime con tante cifre significative quante ne ha il fattore (o il dividendo/divisore) meno preciso.

Esempio di moltiplicazione: 2,34 × 1,2 × 0,503 = 1,412424… ⟶ 1,4 (2 cifre significative, perché 1,2 ne ha 2).

Esempio di divisione: 12,00 ÷ 3,4 = 3,5294… ⟶ 3,5 (2 cifre significative).

Regola pratica di arrotondamento: se la prima cifra eliminata è maggiore di 5, si arrotonda per eccesso; se minore di 5, per difetto; se è 5 seguito solo da zeri, si può adottare una regola coerente (ad es. arrotondamento alla cifra pari) per evitare bias sistematici.

Esponenti

Nel calcolo di potenze e radici, il numero di cifre significative del risultato coincide con quello del numero di partenza (trascurando l’eventuale contributo di incertezza dell’esponente, se esatto). Per esempio:

\((9,81 \times 10^{1})^{2} = 9,62 \times 10^{3}\) (3 cifre significative in ingresso e in uscita);

\((7,2 \times 10^{3})^{1/2} = 8,5 \times 10^{1}\) (2 cifre significative).

Logaritmi

Nel logaritmo in base 10, la caratteristica (parte intera) indica l’ordine di grandezza, mentre la mantissa (parte decimale) trasporta l’informazione di precisione. La regola operativa è: il numero di cifre decimali della mantissa del logaritmo deve eguagliare il numero di cifre significative del numero originario.

Esempio: se \(P = 3,2 \times 10^{4}\ \text{atm}\), allora \(\log_{10} P = 4,51\). La mantissa 0,51 ha due cifre decimali perché P ha due cifre significative. Viceversa, \(\mathrm{antilog}(4,51) = 3,2 \times 10^{4}\).

Numeri esatti e numeri misurati

I numeri misurati sono affetti da incertezza e il loro ultimo digit significativo è incerto. I numeri esatti, invece, non hanno incertezza associata e derivano da definizioni o da conteggi. Nel Sistema Internazionale, i prefissi e molte relazioni tra unità sono esatte: 1 m = 100 cm, 1 L = 1000 mL, 60 s = 1 min. Anche alcune conversioni inter-sistema sono per definizione esatte (ad esempio, 1 in = 2,54 cm esatti). Dal 2019, costanti come il numero di Avogadro sono fissate esattamente per definizione: \(N_\mathrm{A} = 6{,}02214076 \times 10^{23}\ \text{mol}^{-1}\).

Poiché i numeri esatti non introducono incertezza, essi non limitano il numero di cifre significative del risultato finale. Una regola pratica utile nel sistema metrico decimale è che sia la quantità da convertire, e non il fattore di conversione esatto, a determinare quante cifre significative compaiono nel valore convertito.

In sintesi: distinguere tra errori casuali e sistematici, riportare con coerenza le cifre significative e quantificare l’incertezza consente di comunicare risultati misurati in modo rigoroso e confrontabile, migliorando al contempo l’affidabilità attraverso repliche, tarature e controlli di qualità.